什么是边缘人工智能计算?

什么是边缘人工智能计算?现代 AI 盒子的工程解决方案

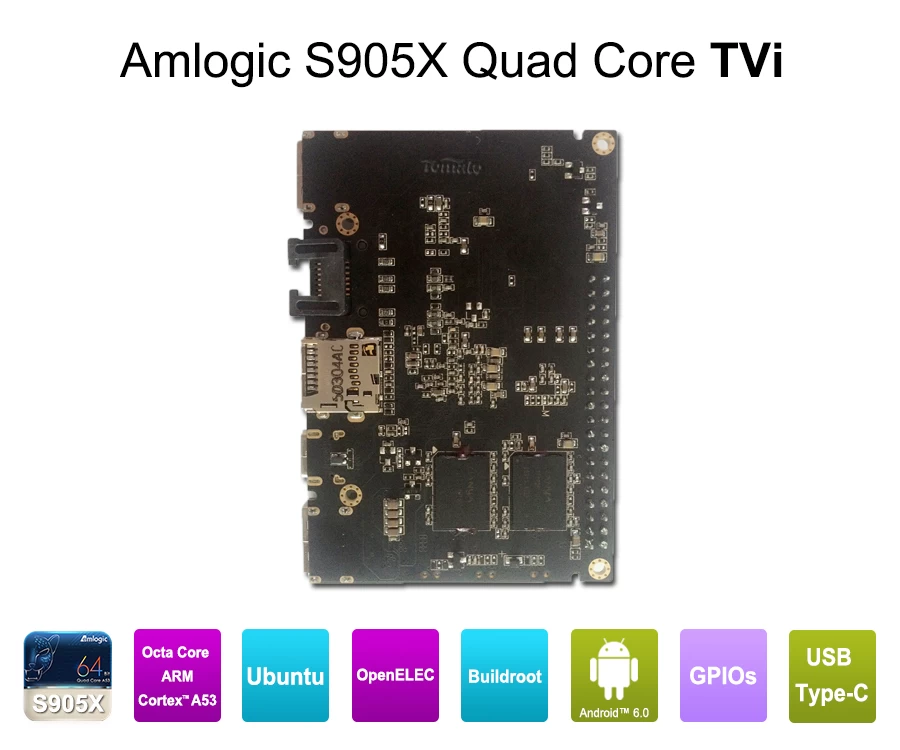

将专用神经处理单元 (NPU) 集成到下一代芯片(例如 Amlogic A311D2 和 Rockchip RK3588 SoC)中,从根本上改变了深度学习的拓扑中心。完全依赖远程云服务器进行实时视频分析、数字标牌自动化或智能城市部署会带来不可接受的延迟并暴露关键的带宽瓶颈。

为了绕过这些限制,工程师部署了 人工智能盒子:本地化计算端点,直接在数据源处处理数据摄取、解密和神经网络推理。

边缘推理的架构

边缘人工智能计算简单来说就是在物理设备上本地执行人工智能算法,而不是将原始数据传输到集中式云端进行处理。

当标准机顶盒接收AV1或H.265视频流时,其主要功能是解码和渲染。然而,人工智能盒子 必须解码流,通过本地化机器学习模型(例如用于对象检测的 YOLOv8)处理帧,并根据推理结果立即触发物理或基于软件的操作。

这需要从根本上偏离标准零售媒体播放器的架构。消费级硬件专为间歇性、低强度任务而设计。当承担连续神经网络处理的任务时,通用板会遭受严重的热节流、数据包丢失和最终的硬件故障。

克服散热和硬件限制

运行连续推理模型的高性能 人工智能盒子 会产生巨大的热负载。现成的塑料外壳和标准散热器不足以满足工业环境的需要。

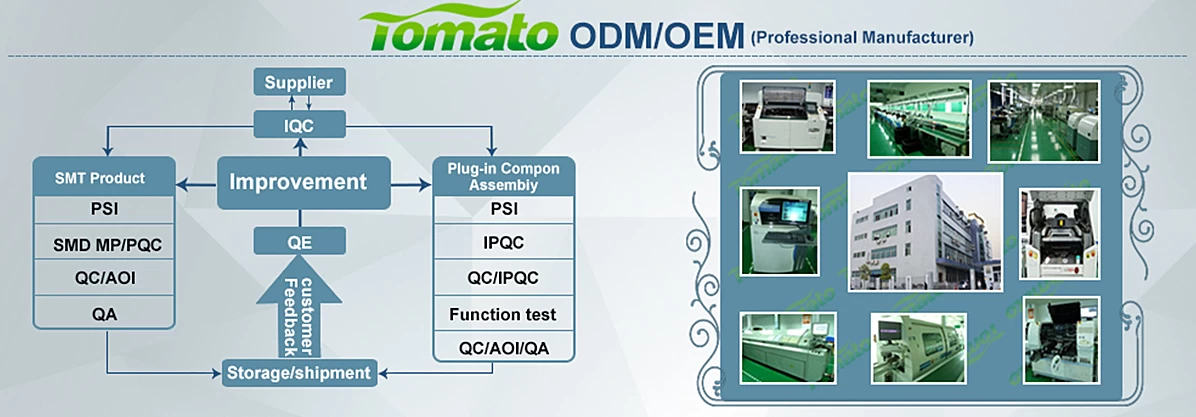

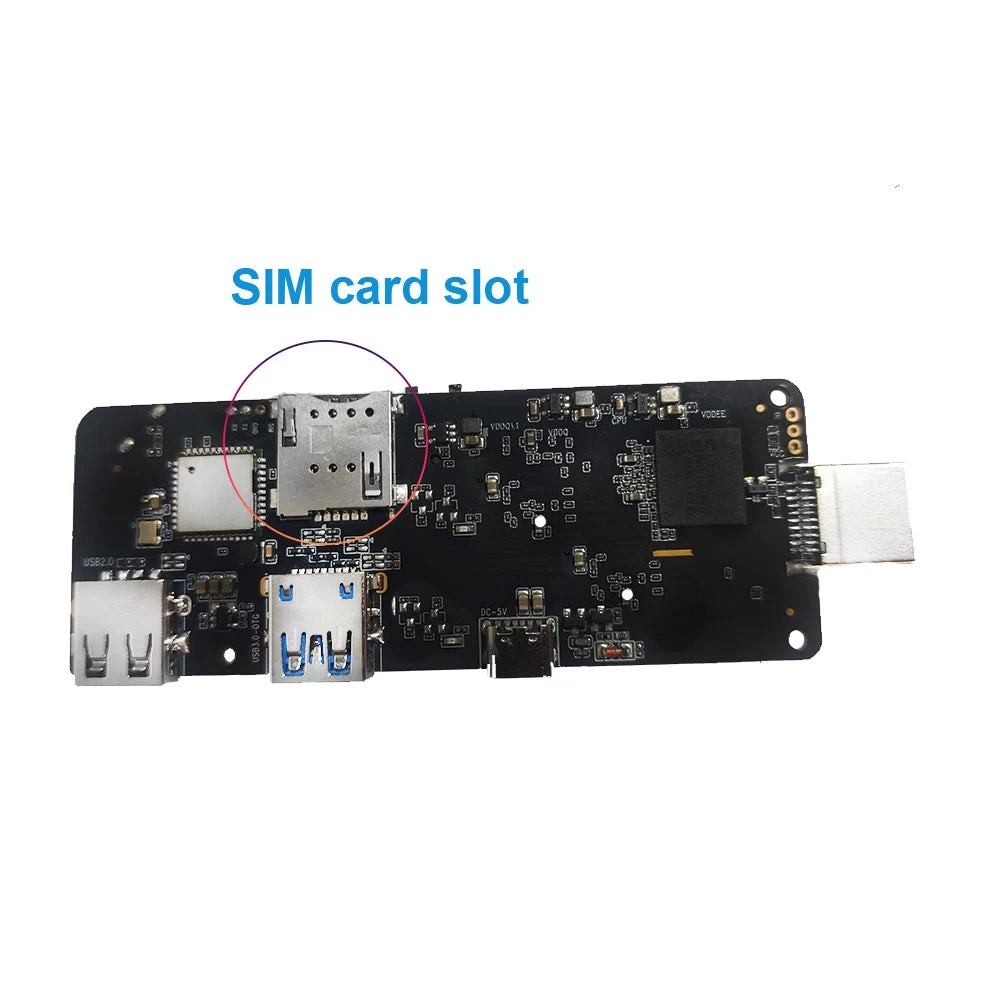

这就是真正的 OEM/ODM 能力决定项目成功的地方。在 SZTomato,我们的硬件修改方法完全由热量和操作数据驱动。我们执行定制的 PCBA 布局修改,以隔离高热组件,确保 NPU 和 CPU 保持峰值频率而无需节流。通过设计专门的冷却解决方案(从挤压铝制机箱集成到定制热界面材料),我们即使在恶劣的、非气候控制的环境中也能保证 24/7 持续推理。

固件级工程:解锁 NPU

部署成功的边缘人工智能解决方案需要芯片和操作系统之间的深度协同。仅在板上安装 NPU 并不能保证客户端软件可以使用它。

标准 Android TV 操作系统针对媒体消费而非工业数据路由进行锁定和优化。我们执行完整的 Linux/Android 内核优化,去除不必要的消费者臃肿软件并公开硬件加速所需的驱动程序。

我们的工程团队提供完整的SDK/API集成,允许系统集成商直接访问NPU、ISP和硬件解码器。这种固件级控制可确保:

-

自定义 UI/UX 部署:为最终用户量身定制的无缝信息亭模式或专有应用程序启动器。

-

加密数据管道:硬件级 HDCP 加密和安全启动协议,用于保护设备上存储的专有机器学习模型。

-

远程车队管理:实施强大、静默的 OTA 更新系统,允许管理员将新固件或更新的神经网络权重推送到数千个已部署的设备,而无需用户干预。

系统集成商的问题解决方案矩阵

采购经理和系统集成商在采购产品时经常遇到三个不同的障碍 人工智能盒子:

-

外设瓶颈:标准板缺乏工业传感器所需的特定 I/O。解决方案:SZTomato 修改 PCBA,包括 RS232、RS485、双千兆 LAN 或定制 GPIO 配置。

-

软件不兼容:客户端软件无法触发硬件NPU,默认CPU,导致系统崩溃。解决方案:深度 AOSP 源代码修改和自定义 SDK 提供,以将客户端应用程序与芯片架构连接起来。

-

部署不稳定:设备由于长时间正常运行而发生内存泄漏而崩溃。解决方案:自定义固件和自动看门狗定时器内严格的内存管理工程,以确保持久的正常运行时间。

采购边缘定制硬件

边缘人工智能计算不是一个未来的概念;而是一个未来的概念。它是安全、低延迟工业网络的当前操作标准。实现可靠的性能需要摆脱通用硬件并与能够进行真正组件级工程的制造商合作。

对于规划下一步部署的 B2B 采购经理、网络架构师和系统集成商来说,SZTomato 提供了将特定 AI 模型带到边缘所需的硬件基础和固件架构。立即联系我们的工程团队讨论 PCBA 修改、定制 SDK 要求和 OEM 生产能力。