Vaut-il la peine d’acheter une AI Box ?

Vaut-il la peine d’acheter une boîte IA ? Architecture des déploiements Edge à haut rendement

La latence du cloud rend la vision par ordinateur en temps réel pratiquement inutile dans les environnements de vision industrielle et d'affichage numérique réactifs. Le recours à l'inférence de serveur centralisée entraîne des coûts de bande passante insoutenables et introduit des vulnérabilités critiques lors de la dégradation du réseau. La solution matérielle conçue pour remédier à cette défaillance structurelle est le Boîte IA.

Cependant, la mise à niveau d’une infrastructure de déploiement depuis des boîtiers Android TV standard vers du matériel Boîte IA spécialisé nécessite une dépense d’investissement importante. Pour les intégrateurs B2B et les responsables des achats, déterminer si une Boîte IA « en vaut la peine » nécessite une évaluation stricte des demandes de traitement localisées par rapport aux coûts du matériel.

Évaluation de la latence et du goulot d'étranglement de la bande passante

Les décodeurs standard et les mini PC commerciaux utilisent des processeurs et des GPU à usage général. Ces architectures sont très inefficaces pour exécuter les multiplications matricielles denses requises par les frameworks d'apprentissage automatique comme TensorFlow ou PyTorch. Lorsqu'un appareil standard capture des données visuelles, telles que des analyses d'audience dans un kiosque de vente au détail, il doit compresser la vidéo, la transmettre à un serveur cloud, attendre son traitement et recevoir en retour la charge utile des instructions.

Une Boîte IA élimine ce cycle. En intégrant une unité de traitement neuronal (NPU) dédiée directement sur le système sur puce (SoC), l'appareil exécute des modèles d'inférence localement. Si votre déploiement nécessite des temps de réponse inférieurs à 10 millisecondes ou fonctionne dans des environnements avec une bande passante de liaison montante restreinte, le changement architectural vers une AI Box est une exigence infrastructurelle obligatoire et non une mise à niveau facultative.

Faire correspondre les capacités du NPU aux exigences de la charge de travail

La principale mesure pour évaluer une AI Box est TOPS (Tera Operations Per Second). Le retour sur investissement de l'appareil évolue directement en fonction de votre capacité à utiliser sa capacité de calcul sans déclencher de limitation thermique.

-

Charges de travail légères (1-2 TOPS) : suffisantes pour la reconnaissance audio de base, la détection de mots d'activation et un contrôle d'accès biométrique simple.

-

Charges de travail lourdes (5 TOPS) : requis pour l'analyse vidéo multi-flux simultanée. Le matériel utilisant des chipsets comme le Rockchip RK3588 offre jusqu'à 6 TOPS, permettant simultanément la détection d'objets, la reconnaissance faciale et le comptage de véhicules directement en périphérie.

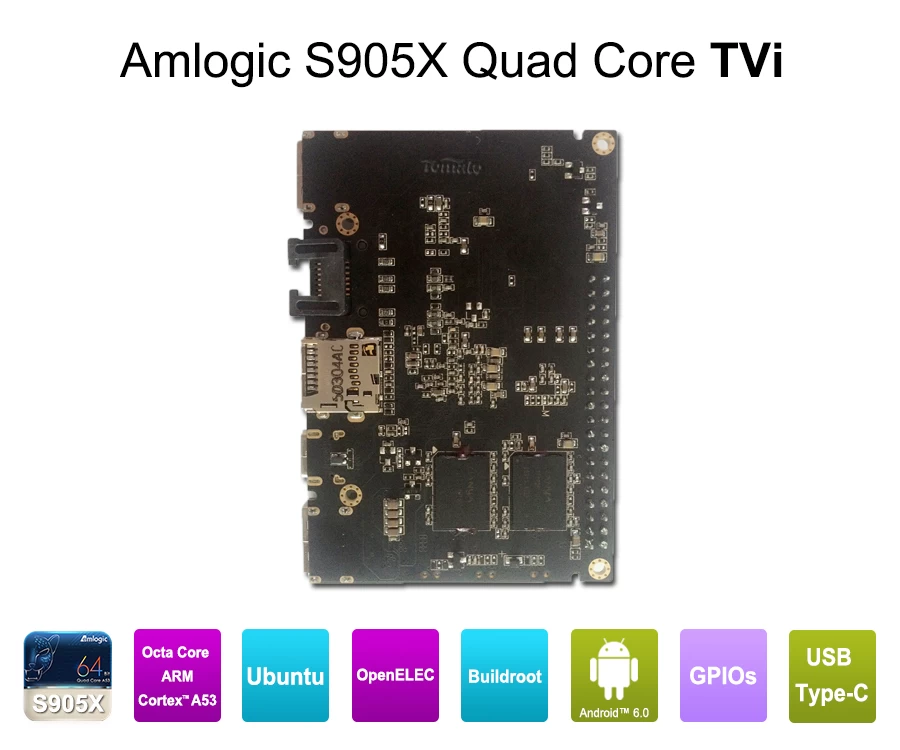

Si votre application ne nécessite pas de vision par ordinateur ou d’algorithmes prédictifs complexes, le déploiement d’une AI Box haut de gamme entraîne une capacité de calcul bloquée et un retour sur investissement négatif. Un lecteur multimédia de streaming standard basé sur Amlogic est suffisant pour le décodage multimédia passif.

Économie du matériel : le coût total de possession de l'inférence localisée

Bien que le coût unitaire initial d'une AI Box soit plus élevé que celui du matériel existant, le coût total de possession (TCO) s'inverse souvent au cours des 12 premiers mois de déploiement en entreprise en raison de trois facteurs :

-

Réductions des API cloud : le traitement des données localement élimine les frais récurrents associés aux API d'apprentissage automatique basées sur le cloud.

-

Évitement de l'infrastructure du serveur : le traitement Edge décentralise la charge de calcul, évitant ainsi le besoin de mises à niveau centralisées coûteuses du serveur à mesure que votre affichage numérique ou votre réseau IoT évolue.

-

Conformité à la confidentialité des données : en traitant les flux vidéo localement et en supprimant instantanément les images brutes, les AI Box se conforment structurellement aux cadres stricts de confidentialité des données (par exemple, RGPD, CCPA), atténuant ainsi les risques juridiques et les frais de conformité.

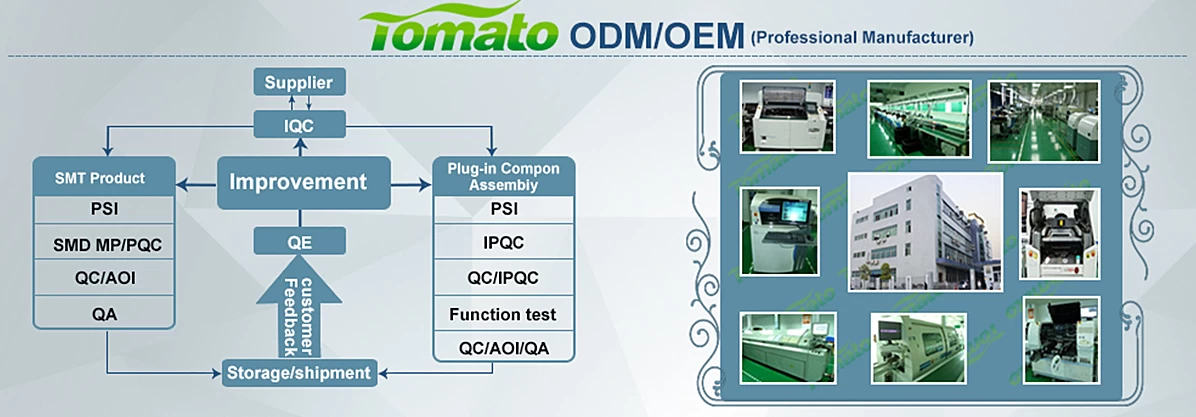

La nécessité du PCBA et de l'ingénierie du micrologiciel

L’achat de matériel d’IA grand public pour un déploiement B2B garantit l’échec. Les applications industrielles exigent une personnalisation OEM/ODM rigoureuse.

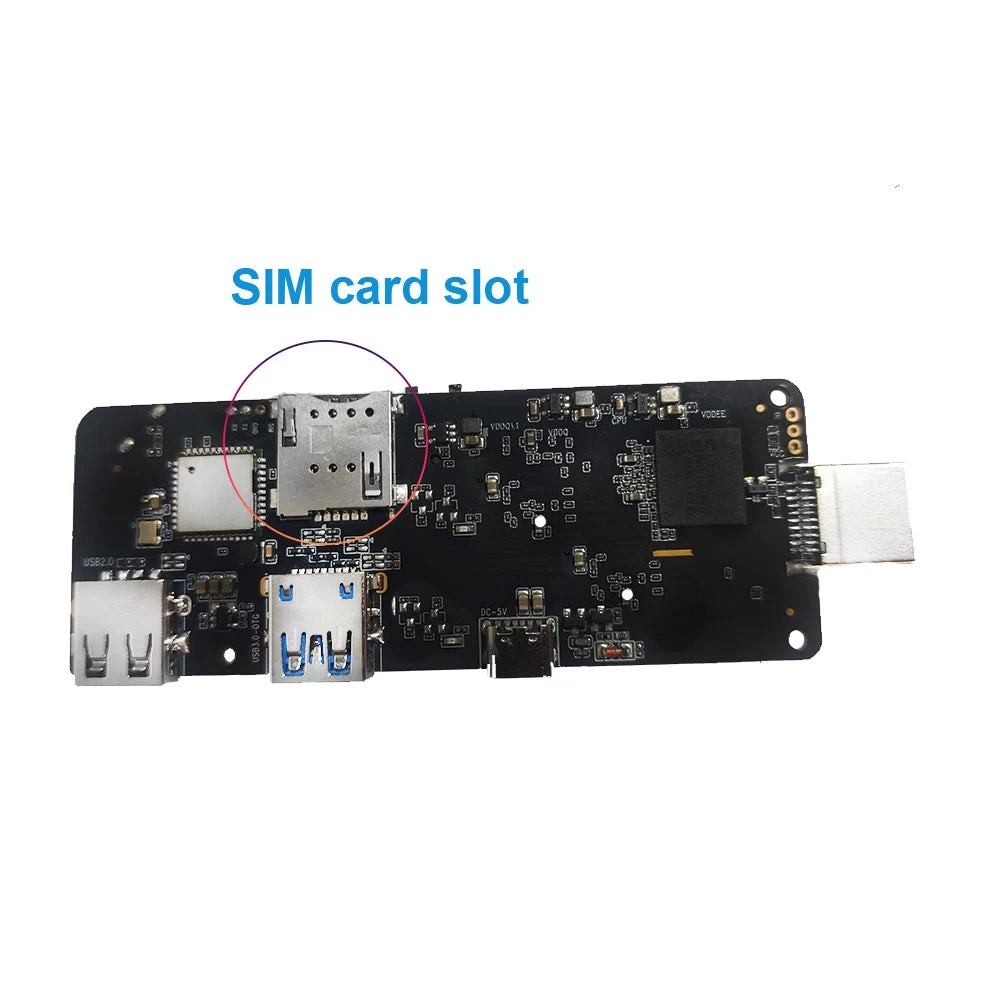

Une AI Box prête à l’emploi ne comportera pas les configurations d’E/S spécifiques (RS232, LAN double gigabit, GPIO) requises pour l’intégration industrielle. De plus, une utilisation soutenue du NPU génère des charges thermiques aiguës. Une boîte AI viable nécessite une conception d'assemblage de carte de circuit imprimé (PCBA) personnalisée combinée à des boîtiers en aluminium extrudé et à un montage stratégique du dissipateur thermique pour garantir un fonctionnement continu 24h/24 et 7j/7. Enfin, les intégrateurs d'entreprise ont besoin d'une ingénierie approfondie du micrologiciel, y compris le verrouillage du chargeur de démarrage et la compilation personnalisée du projet Android Open Source (AOSP), pour verrouiller le système et intégrer des SDK propriétaires.

Recommandation stratégique

La décision d'acquérir un AI Box dépend entièrement de votre couche d’application. Si votre réseau affiche passivement du contenu, un matériel standard suffit. Si votre infrastructure repose sur l’ingestion de données en temps réel, l’exécution d’un apprentissage automatique local et des réponses mécaniques ou numériques à latence nulle, l’AI Box est le seul choix architectural viable.

Évaluez les goulots d'étranglement de votre réseau actuel, calculez vos dépenses mensuelles d'inférence cloud et consultez une équipe d'ingénierie matérielle OEM/ODM dédiée pour spécifier les exigences NPU exactes et les modifications PCBA nécessaires pour votre prochain déploiement.