Vale la pena acquistare un AI Box?

Vale la pena acquistare un Scatola AI? Architettura di implementazioni edge ad alto rendimento

La latenza del cloud rende la visione artificiale in tempo reale praticamente inutile negli ambienti di visione artificiale industriale e di segnaletica digitale reattiva. La dipendenza dall’inferenza dei server centralizzati comporta costi di larghezza di banda insostenibili e introduce vulnerabilità critiche durante il degrado della rete. La soluzione hardware progettata per risolvere questo cedimento strutturale è la Scatola AI.

Tuttavia, l’aggiornamento di un’infrastruttura di distribuzione dai TV box Android standard all’hardware specializzato Scatola AI richiede una spesa in conto capitale significativa. Per gli integratori B2B e i responsabili degli acquisti, determinare se un Scatola AI "vale la pena" richiede una valutazione rigorosa delle richieste di elaborazione localizzate rispetto ai costi dell'hardware.

Valutazione del collo di bottiglia della latenza e della larghezza di banda

I set-top box standard e i mini PC commerciali utilizzano CPU e GPU per uso generico. Queste architetture sono altamente inefficienti nell’eseguire le dense moltiplicazioni di matrici richieste dai framework di machine learning come TensorFlow o PyTorch. Quando un dispositivo standard acquisisce dati visivi, come l'analisi del pubblico in un chiosco di vendita al dettaglio, deve comprimere il video, trasmetterlo a un server cloud, attendere l'elaborazione e ricevere indietro il payload delle istruzioni.

Una AI Box elimina questo ciclo. Integrando un'unità di elaborazione neurale (NPU) dedicata direttamente nel System on a Chip (SoC), il dispositivo esegue modelli di inferenza localmente. Se la tua implementazione richiede tempi di risposta inferiori a 10 millisecondi o opera in ambienti con larghezza di banda uplink limitata, il passaggio all'architettura verso un AI Box è un requisito infrastrutturale obbligatorio, non un aggiornamento facoltativo.

Abbinamento delle capacità della NPU ai requisiti del carico di lavoro

La metrica principale per valutare un AI Box è TOPS (Tera Operations Per Second). Il ROI del dispositivo si adatta direttamente alla tua capacità di utilizzare la sua capacità di elaborazione senza attivare la limitazione termica.

-

Carichi di lavoro leggeri (1-2 TOP): sufficienti per il riconoscimento audio di base, il rilevamento delle parole di attivazione e un semplice controllo biometrico degli accessi.

-

Carichi di lavoro pesanti (5 TOPS): richiesto per l'analisi video multi-stream simultanea. L'hardware che utilizza chipset come Rockchip RK3588 offre fino a 6 TOPS, consentendo il rilevamento simultaneo di oggetti, il riconoscimento facciale e il conteggio dei veicoli direttamente sul bordo.

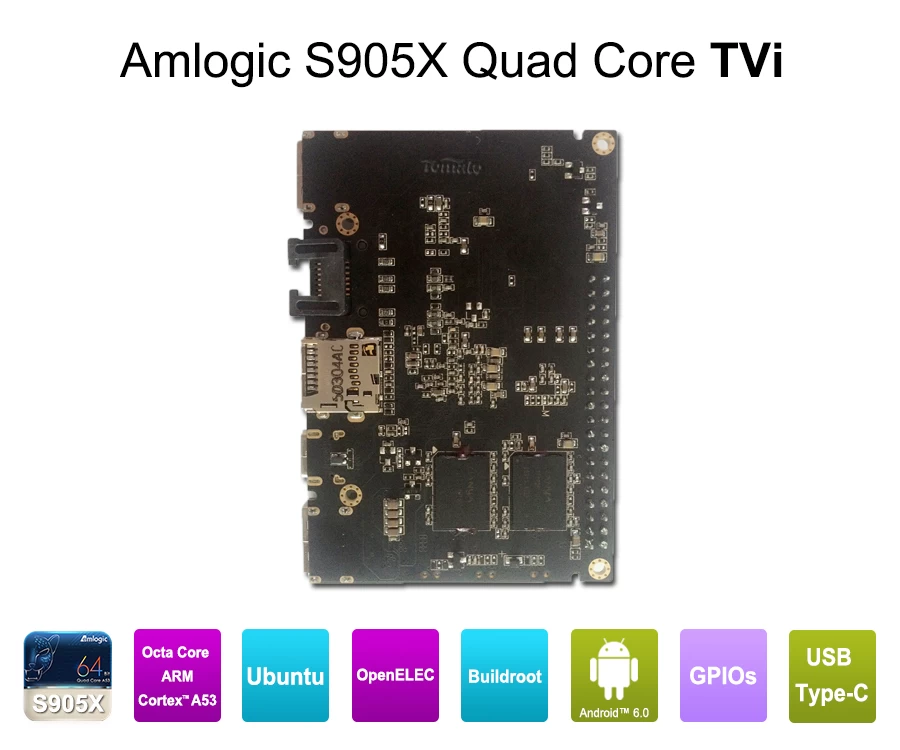

Se la tua applicazione non richiede visione artificiale o algoritmi predittivi complessi, l'implementazione di un AI Box ad alto TOPS si traduce in capacità di elaborazione non recuperabile e un ROI negativo. Un lettore multimediale in streaming standard basato su Amlogic è sufficiente per la decodifica multimediale passiva.

Economia dell'hardware: il TCO dell'inferenza localizzata

Sebbene il costo unitario iniziale di un AI Box sia superiore a quello dell'hardware legacy, il costo totale di proprietà (TCO) spesso cambia entro i primi 12 mesi di implementazione aziendale a causa di tre fattori:

-

Riduzioni delle API cloud: l'elaborazione dei dati a livello locale elimina i costi ricorrenti associati alle API di machine learning basate su cloud.

-

Evitare l'infrastruttura server: l'elaborazione edge decentralizza il carico di elaborazione, evitando la necessità di costosi aggiornamenti centralizzati del server man mano che la segnaletica digitale o la rete IoT crescono.

-

Conformità alla privacy dei dati: elaborando i feed video localmente ed eliminando istantaneamente il filmato non elaborato, gli AI Box rispettano strutturalmente i rigorosi quadri sulla privacy dei dati (ad esempio GDPR, CCPA), mitigando i rischi legali e i costi di conformità.

La necessità del PCBA e dell'ingegneria del firmware

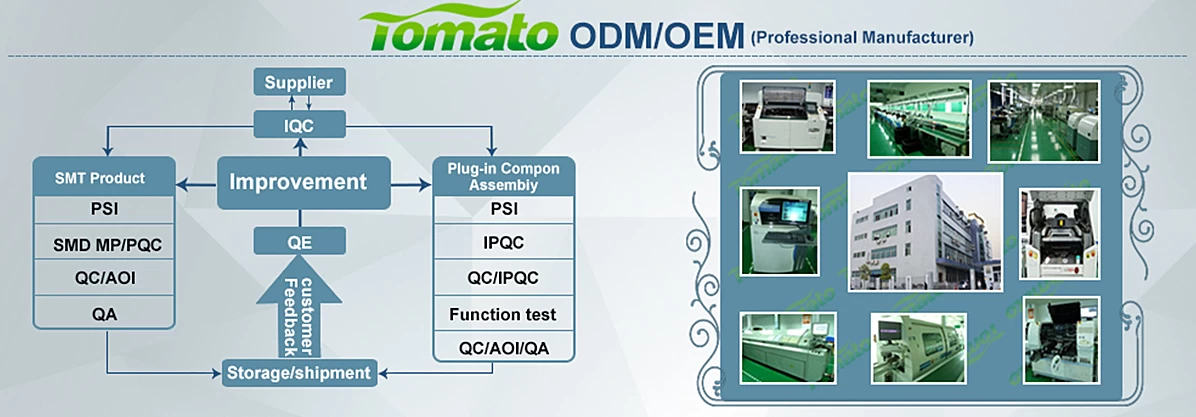

L'acquisto di hardware AI di livello consumer per l'implementazione B2B garantisce il fallimento. Le applicazioni industriali richiedono una rigorosa personalizzazione OEM/ODM.

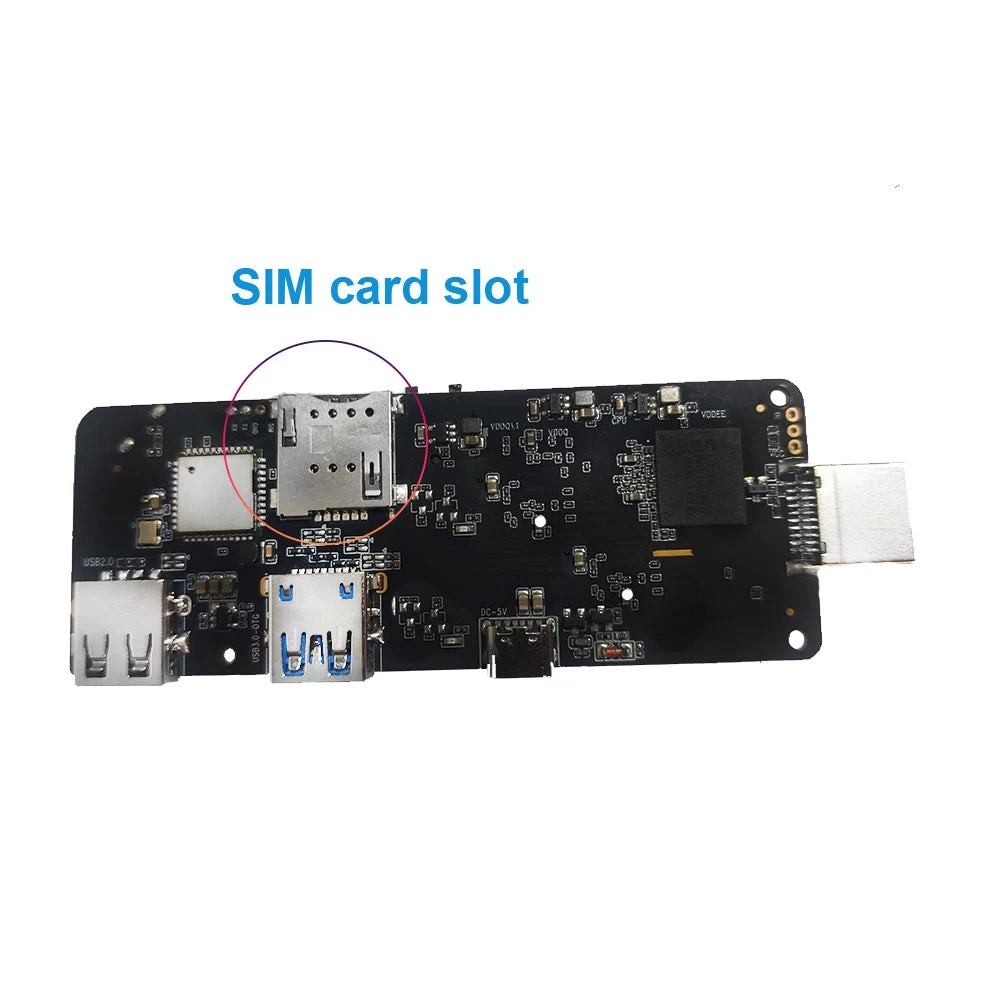

Un AI Box standardizzato non presenterà le configurazioni I/O specifiche (RS232, dual gigabit LAN, GPIO) richieste per l'integrazione industriale. Inoltre, l’utilizzo prolungato della NPU genera carichi termici acuti. Un AI Box valido richiede un design personalizzato del gruppo scheda a circuito stampato (PCBA) combinato con involucri in alluminio estruso e montaggio strategico del dissipatore di calore per garantire un funzionamento continuo 24 ore su 24, 7 giorni su 7. Infine, gli integratori aziendali richiedono un'approfondita progettazione del firmware, compreso il blocco del bootloader e la compilazione personalizzata di Android Open Source Project (AOSP), per bloccare il sistema e integrare SDK proprietari.

Raccomandazione strategica

La decisione di procurarsi un AI Box dipende interamente dal livello dell'applicazione. Se la tua rete visualizza passivamente i contenuti, è sufficiente l'hardware standard. Se la tua infrastruttura si basa sull'acquisizione di dati in tempo reale, sull'esecuzione locale del machine learning e su risposte meccaniche o digitali a latenza zero, AI Box è l'unica scelta architetturale praticabile.

Valuta i colli di bottiglia della tua rete attuale, calcola le spese mensili per l'inferenza del cloud e consulta un team di ingegneri hardware OEM/ODM dedicato per specificare gli esatti requisiti NPU e le modifiche PCBA necessarie per la tua prossima distribuzione.