Vale la pena usare l'AI Box?

Vale la pena usare le Scatola AI? Un'analisi tecnica del ROI per gli integratori B2B

Affidarsi all'infrastruttura cloud per l'analisi video in tempo reale introduce due punti critici di fallimento per le implementazioni commerciali: latenza API inaccettabile e costi ricorrenti esorbitanti della larghezza di banda. Quando una rete di segnaletica digitale al dettaglio o una rete di sorveglianza industriale richiede una visione computerizzata continua per il riconoscimento degli oggetti, la trasmissione di feed video 4K grezzi a un server centralizzato è un passo falso architettonico fondamentale.

Questo collo di bottiglia ha accelerato l’adozione di Scatola AI, un dispositivo hardware dedicato progettato per elaborare i carichi di lavoro di machine learning direttamente all’edge. Tuttavia, per i responsabili degli acquisti B2B e gli integratori di sistemi, la transizione dai lettori multimediali standard all’hardware dotato di NPU richiede una significativa spesa in conto capitale iniziale. Determinare se vale la pena investire in un Scatola AI richiede una valutazione rigorosa delle capacità di elaborazione localizzate, delle tolleranze termiche e del conseguente costo totale di proprietà (TCO).

Il problema della larghezza di banda: inferenza del cloud e edge computing

I TV Box Android standard e i lettori di segnaletica digitale fungono da thin client; estraggono i dati da un server e li visualizzano. Quando si introducono requisiti di visione artificiale, come l'analisi demografica del pubblico o il monitoraggio di aree riservate, i SOC (System on Chips) standard senza unità di elaborazione neurale (NPU) dedicate soffocano il carico computazionale.

Il tentativo di aggirare questa limitazione hardware scaricando l'inferenza sui fornitori di servizi cloud (AWS, Google Cloud) crea un grave drenaggio finanziario. Una rete aziendale che elabora centinaia di flussi video simultanei comporta tariffe in uscita enormi. La distribuzione di un Scatola AI risolve questo problema eseguendo i modelli di machine learning (TensorFlow Lite, PyTorch, ONNX) localmente. L'AI Box elabora i dati visivi, estrae i metadati (ad esempio, "Uomo, 35-45, ha guardato il display per 12 secondi") e invia solo pochi kilobyte di dati di testo al server centrale. La riduzione dei costi della larghezza di banda spesso giustifica l'aggiornamento dell'hardware entro il primo anno operativo.

Valutazione dei benchmark NPU e dei vincoli hardware

La caratteristica distintiva di un AI Box è la NPU, misurata in TOPS (trilioni di operazioni al secondo). Tuttavia, le metriche TOPS grezze vengono spesso manipolate nelle schede tecniche dei consumatori. Per le applicazioni industriali, le prestazioni sostenute sotto carico sono l'unico parametro che conta.

-

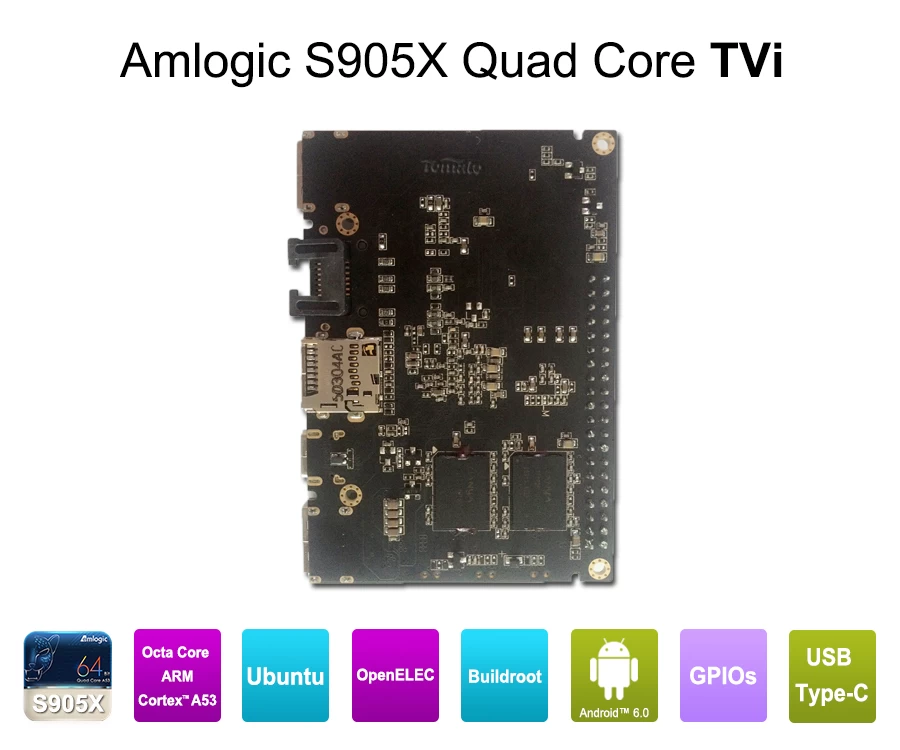

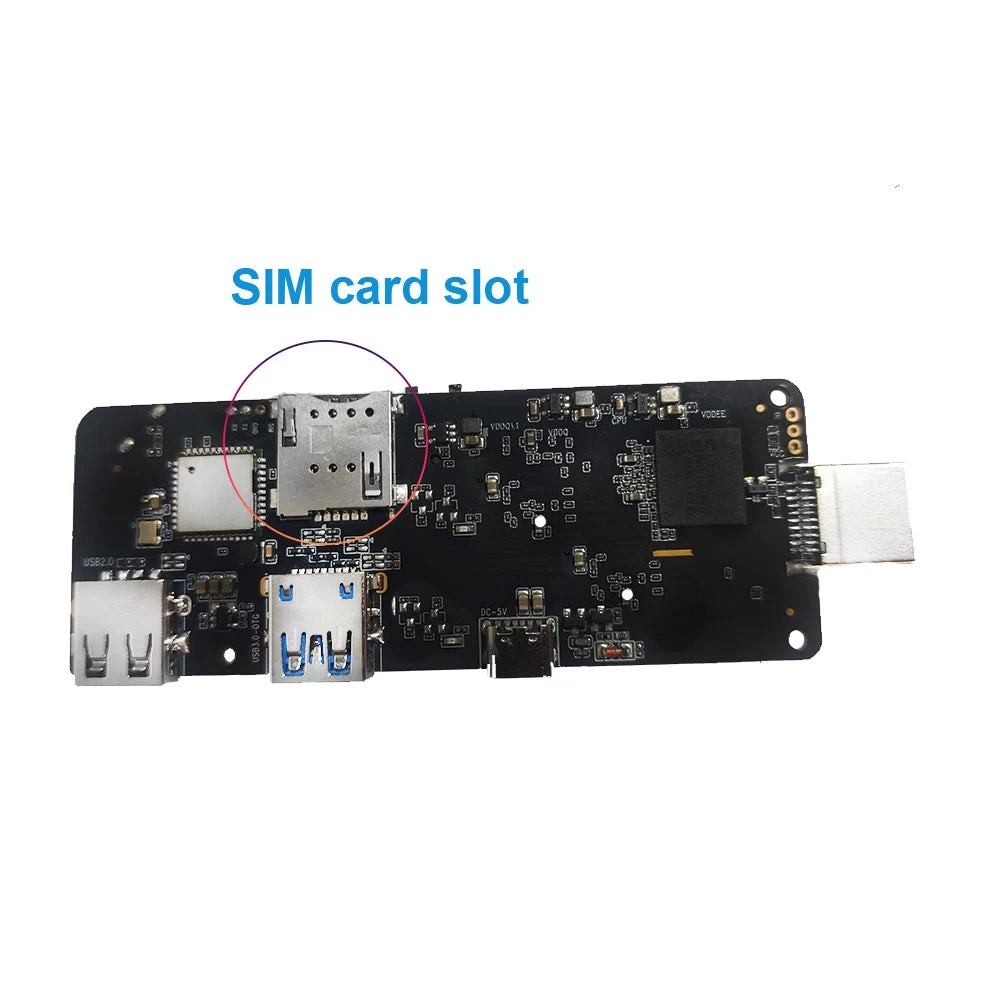

Architettura in silicio: processori come Rockchip RK3588 dominano l'attuale panorama AI Box, offrendo fino a 6,0 TOPS di potenza di calcolo INT8 insieme a una CPU octa-core. Ciò consente al dispositivo di decodificare più flussi video simultanei eseguendo contemporaneamente algoritmi di rilevamento di oggetti complessi.

-

Larghezza di banda della memoria: i carichi di lavoro dell'intelligenza artificiale richiedono molta memoria. Un AI Box dotato di memoria DDR3 standard o eMMC lenta creerà un collo di bottiglia per la NPU. Le implementazioni B2B richiedono RAM LPDDR4x o LPDDR5 (minimo 8 GB per modelli di visione complessi) e storage NVMe o eMMC 5.1 industriale ad alta resistenza per gestire i cicli aggressivi di lettura/scrittura della memorizzazione nella cache dei dati localizzati.

-

Thermal Design Power (TDP): le NPU generano una notevole quantità di calore. Un involucro di plastica standard causerà una limitazione termica nel giro di poche ore, riducendo la precisione dell'inferenza e rendendo il dispositivo inutilizzabile. Un AI Box commerciale richiede un layout PCBA personalizzato con la NPU fisicamente isolata dal PMIC (Power Management IC), alloggiata in un telaio in alluminio estruso alettato che funge da dissipatore di calore passivo.

Ingegneria del firmware: il livello di integrazione trascurato

Un AI Box è funzionalmente inerte senza un livello firmware ottimizzato che collega l'hardware e il software proprietario del cliente. Le build Android consumer standard (AOSP) limitano l'accesso approfondito al sistema necessario per l'integrazione dell'edge computing.

L'implementazione di un AI Box su larga scala richiede un'ingegneria del firmware personalizzata:

-

Accesso a livello root e hook API: gli integratori richiedono l'accesso API diretto alla NPU per allocare thread hardware specifici ai loro modelli proprietari.

-

Flessibilità del sistema operativo: sebbene molte applicazioni di segnaletica digitale funzionino su Android, l'inferenza pesante dell'intelligenza artificiale spesso richiede la stabilità e la gestione dei pacchetti di Linux (Ubuntu/Debian). Un partner hardware competente deve offrire funzionalità dual-boot o Board Support Package (BSP) personalizzati per più sistemi operativi.

-

Gestione remota: la gestione di una flotta di dispositivi edge computing richiede un'infrastruttura di aggiornamento sicura Over-The-Air (OTA) e timer di watchdog per riavviare automaticamente l'hardware in caso di arresto anomalo dell'applicazione localizzata.

Analisi costi-benefici: il TCO a 18 mesi

Le AI Box valgono il premio? La risposta sta nell’analisi del TCO a 18 mesi. Mentre un AI Box può costare dal 200% al 300% in più rispetto a un lettore di segnaletica digitale standard, i risparmi operativi sono immediati.

Eliminando i costi ricorrenti delle connessioni ISP commerciali a larghezza di banda elevata, riducendo le chiamate API di cloud computing del 95% e utilizzando componenti di livello industriale che riducono il tasso di errore RMA, il punto di pareggio per una rete di edge computing localizzata si verifica in genere tra il mese 12 e il mese 18 di implementazione.

Per gli integratori B2B che stanno passando alla vendita al dettaglio intelligente, alla sicurezza autonoma o all'IoT industriale, il AI Box non è un aggiornamento discrezionale; è un requisito architettonico obbligatorio. Per valutare i requisiti specifici della NPU, i progetti termici e le configurazioni firmware personalizzate necessarie per l'implementazione dell'edge computing, consulta un produttore OEM specializzato per progettare una soluzione in linea con i vincoli del tuo progetto.