AI Box는 그만한 가치가 있나요?

AI 박스는 가치가 있나요? B2B 통합업체를 위한 기술 ROI 분석

실시간 비디오 분석을 위해 클라우드 인프라에 의존하면 상업용 배포에 두 가지 중요한 실패 지점이 발생합니다. 바로 허용할 수 없는 API 대기 시간과 엄청난 반복 대역폭 비용입니다. 소매 디지털 간판 네트워크 또는 산업 감시 그리드에 객체 인식을 위한 지속적인 컴퓨터 비전이 필요한 경우 원시 4K 비디오 피드를 중앙 서버로 전송하는 것은 근본적인 아키텍처 실수입니다.

이러한 병목 현상으로 인해 머신 러닝 워크로드를 엣지에서 직접 처리하도록 설계된 전용 하드웨어 어플라이언스인 AI 박스의 채택이 가속화되었습니다. 그러나 B2B 조달 담당자 및 시스템 통합업체의 경우 표준 미디어 플레이어에서 NPU 장착 하드웨어로 전환하려면 상당한 초기 자본 지출이 필요합니다. AI 박스가 투자 가치가 있는지 판단하려면 국부적인 처리 능력, 열 내성 및 그에 따른 총 소유 비용(TCO)을 엄격하게 평가해야 합니다.

대역폭 문제: 클라우드 추론과 엣지 컴퓨팅

표준 Android TV Box와 디지털 사이니지 플레이어는 씬 클라이언트 역할을 합니다. 서버에서 데이터를 가져와서 표시합니다. 청중 인구통계 분석이나 제한 구역 모니터링과 같은 컴퓨터 비전 요구 사항을 도입할 때 전용 NPU(신경 처리 장치)가 없는 표준 SOC(시스템 온 칩)는 계산 부하를 방해합니다.

클라우드 제공업체(AWS, Google Cloud)에 추론을 오프로드하여 이러한 하드웨어 제한을 우회하려고 시도하면 심각한 재정적 손실이 발생합니다. 수백 개의 동시 비디오 스트림을 처리하는 기업 네트워크에는 막대한 송신 비용이 발생합니다. AI 박스를 배포하면 기계 학습 모델(TensorFlow Lite, PyTorch, ONNX)을 로컬에서 실행하여 이 문제를 해결합니다. AI 박스는 시각적 데이터를 처리하고 메타데이터(예: "35-45세 남성, 12초 동안 디스플레이를 보았습니다")를 추출한 다음 몇 킬로바이트의 텍스트 데이터만 중앙 서버로 다시 보냅니다. 대역폭 비용 절감으로 인해 첫 번째 운영 연도 내에 하드웨어 업그레이드가 정당화되는 경우가 많습니다.

NPU 벤치마크 및 하드웨어 제약 조건 평가

AI Box의 정의 특성은 TOPS(초당 수조 개의 연산) 단위로 측정되는 NPU입니다. 그러나 원시 TOPS 지표는 소비자 사양서에서 자주 조작됩니다. 산업용 애플리케이션의 경우 부하 시 지속적인 성능이 중요한 유일한 지표입니다.

-

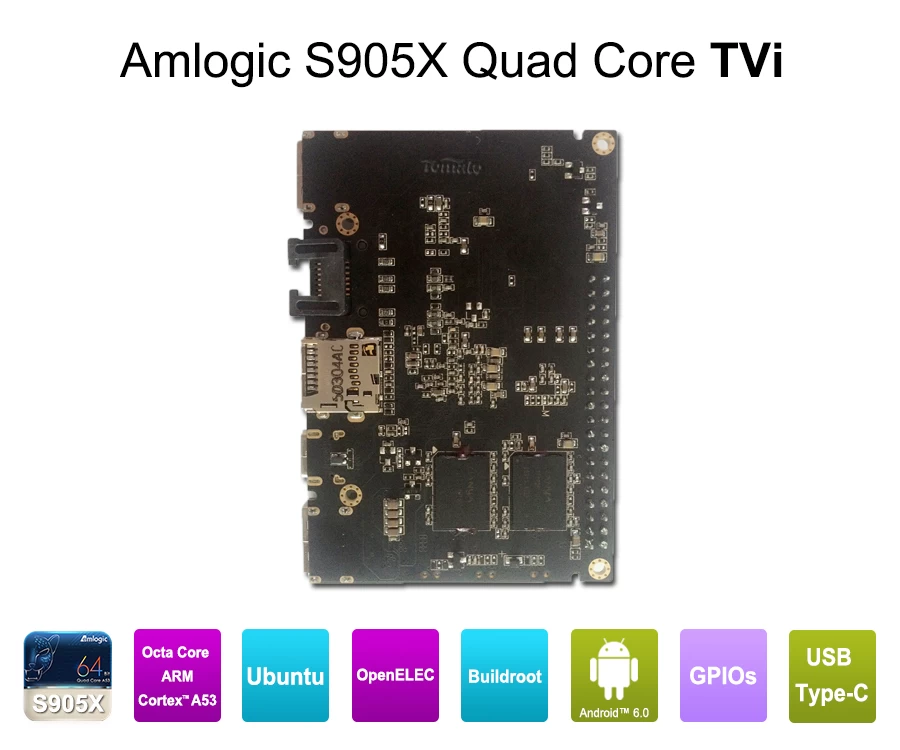

실리콘 아키텍처: Rockchip RK3588과 같은 프로세서는 현재 AI Box 환경을 지배하며 옥타 코어 CPU와 함께 최대 6.0 TOPS의 INT8 컴퓨팅 성능을 제공합니다. 이를 통해 장치는 복잡한 객체 감지 알고리즘을 동시에 실행하면서 동시에 여러 비디오 스트림을 디코딩할 수 있습니다.

-

메모리 대역폭: AI 워크로드는 메모리 집약적입니다. 표준 DDR3 또는 느린 eMMC 스토리지가 장착된 AI Box는 NPU에 병목 현상을 발생시킵니다. B2B 배포에는 지역화된 데이터 캐싱의 공격적인 읽기/쓰기 주기를 처리하기 위해 LPDDR4x 또는 LPDDR5 RAM(복잡한 비전 모델의 경우 최소 8GB)과 내구성이 뛰어난 NVMe 또는 산업용 eMMC 5.1 스토리지가 필요합니다.

-

TDP(열 설계 전력): NPU는 상당한 열을 발생시킵니다. 표준 플라스틱 인클로저는 몇 시간 내에 열 조절을 유발하여 추론 정확도를 떨어뜨리고 장치를 쓸모 없게 만듭니다. 상업용 AI Box에는 PMIC(전력 관리 IC)와 물리적으로 분리된 NPU가 있는 맞춤형 PCBA 레이아웃이 필요하며, 수동 방열판 역할을 하는 핀이 달린 압출 알루미늄 섀시에 내장되어 있습니다.

펌웨어 엔지니어링: 간과된 통합 계층

AI Box는 하드웨어와 클라이언트의 독점 소프트웨어를 연결하는 최적화된 펌웨어 계층이 없으면 기능적으로 비활성입니다. 기성 소비자 Android 빌드(AOSP)는 에지 컴퓨팅 통합에 필요한 심층 시스템 액세스를 제한합니다.

AI Box를 대규모로 배포하려면 맞춤형 펌웨어 엔지니어링이 필요합니다.

-

루트 수준 액세스 및 API 후크: 통합자는 특정 하드웨어 스레드를 독점 모델에 할당하기 위해 NPU에 대한 직접적인 API 액세스가 필요합니다.

-

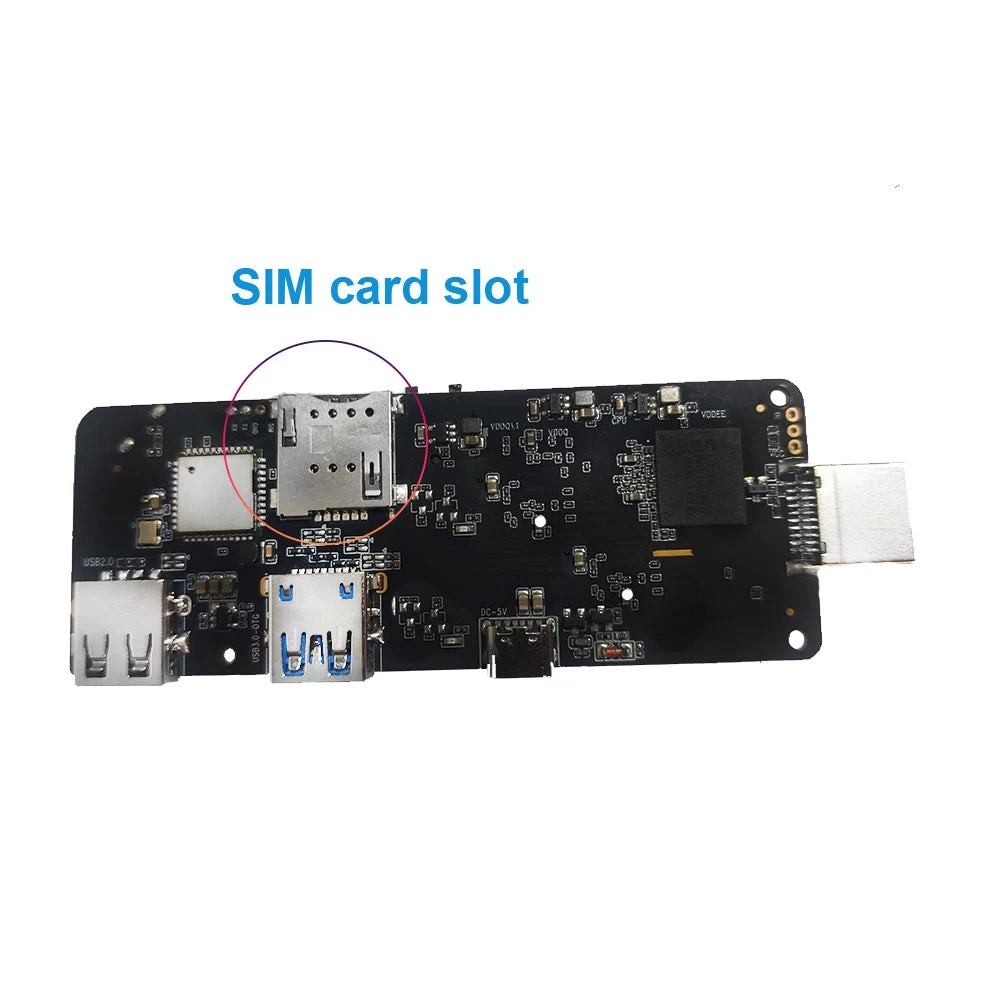

OS 유연성: 많은 디지털 사이니지 애플리케이션이 Android에서 실행되는 반면, 과도한 AI 추론에는 Linux(Ubuntu/Debian)의 안정성과 패키지 관리가 필요한 경우가 많습니다. 유능한 하드웨어 파트너는 여러 운영 체제에 대한 이중 부팅 기능이나 맞춤형 BSP(보드 지원 패키지)를 제공해야 합니다.

-

원격 관리: 다양한 엣지 컴퓨팅 장치를 관리하려면 안전한 OTA(Over-The-Air) 업데이트 인프라와 지역화된 애플리케이션 충돌이 발생할 경우 하드웨어를 자동으로 재부팅하는 감시 타이머가 필요합니다.

비용 편익 분석: 18개월 TCO

AI Box는 프리미엄 가치가 있나요? 그 답은 18개월 TCO를 분석하는 데 있습니다. 동안 AI Box 표준 디지털 사이니지 플레이어보다 선불 비용이 200%~300% 더 높을 수 있지만 운영 비용 절감은 즉각적입니다.

고대역폭 상업용 ISP 연결의 반복 비용을 제거하고, 클라우드 컴퓨팅 API 호출을 95% 줄이고, RMA 실패율을 낮추는 산업용 등급 구성 요소를 활용함으로써 현지화된 엣지 컴퓨팅 네트워크의 손익분기점은 일반적으로 배포 후 12개월에서 18개월 사이에 발생합니다.

스마트 소매, 자율 보안 또는 산업용 IoT로 전환하는 B2B 통합업체의 경우 AI Box 임의 업그레이드가 아닙니다. 이는 필수 아키텍처 요구 사항입니다. 엣지 컴퓨팅 배포에 필요한 특정 NPU 요구 사항, 열 설계 및 맞춤형 펌웨어 구성을 평가하려면 전문 OEM 제조업체에 문의하여 프로젝트 제약 조건에 맞는 솔루션을 설계하세요.