Lohnt sich AI Box?

Lohnen sich KI-Boxen? Eine technische ROI-Analyse für B2B-Integratoren

Der Einsatz einer Cloud-Infrastruktur für Echtzeit-Videoanalysen bringt zwei kritische Fehlerquellen für kommerzielle Bereitstellungen mit sich: inakzeptable API-Latenz und exorbitante wiederkehrende Bandbreitenkosten. Wenn ein Digital-Signage-Netzwerk im Einzelhandel oder ein industrielles Überwachungsnetz eine kontinuierliche Computer-Vision zur Objekterkennung erfordert, ist die Übertragung roher 4K-Video-Feeds an einen zentralen Server ein grundlegender architektonischer Fehltritt.

Dieser Engpass hat die Einführung der KI-Box beschleunigt – einer dedizierten Hardware-Appliance, die für die Verarbeitung von Machine-Learning-Workloads direkt am Edge entwickelt wurde. Für B2B-Einkaufsverantwortliche und Systemintegratoren erfordert der Übergang von Standard-Mediaplayern zu mit NPU ausgestatteter Hardware jedoch einen erheblichen Vorabinvestitionsaufwand. Um festzustellen, ob sich die Investition in eine KI-Box lohnt, ist eine strenge Bewertung der lokalen Verarbeitungsfähigkeiten, thermischen Toleranzen und der daraus resultierenden Gesamtbetriebskosten (TCO) erforderlich.

Das Bandbreitenproblem: Cloud-Inferenz vs. Edge Computing

Standard-Android-TV-Boxen und Digital-Signage-Player fungieren als Thin Clients; Sie rufen Daten von einem Server ab und zeigen sie an. Wenn Sie Computer-Vision-Anforderungen einführen – wie z. B. eine demografische Analyse des Publikums oder die Überwachung von Sperrgebieten – ersticken Standard-SOCs (System on Chips) ohne dedizierte Neural Processing Units (NPUs) an der Rechenlast.

Der Versuch, diese Hardwarebeschränkung zu umgehen, indem die Schlussfolgerung an Cloud-Anbieter (AWS, Google Cloud) verlagert wird, führt zu einer erheblichen finanziellen Belastung. In einem Unternehmensnetzwerk, das Hunderte gleichzeitiger Videostreams verarbeitet, fallen enorme Gebühren für den ausgehenden Datenverkehr an. Der Einsatz einer KI-Box löst dieses Problem, indem die Modelle für maschinelles Lernen (TensorFlow Lite, PyTorch, ONNX) lokal ausgeführt werden. Die KI-Box verarbeitet die visuellen Daten, extrahiert die Metadaten (z. B. „Männlich, 35–45, schaute 12 Sekunden auf das Display“) und sendet nur wenige Kilobyte Textdaten zurück an den zentralen Server. Die Reduzierung der Bandbreitenkosten rechtfertigt häufig das Hardware-Upgrade innerhalb des ersten Betriebsjahres.

Bewertung von NPU-Benchmarks und Hardware-Einschränkungen

Das bestimmende Merkmal einer KI-Box ist die NPU, gemessen in TOPS (Trillions of Operations Per Second). Rohe TOPS-Kennzahlen werden jedoch in Verbraucherdatenblättern häufig manipuliert. Für industrielle Anwendungen ist die dauerhafte Leistung unter Last die einzige Messgröße, die zählt.

-

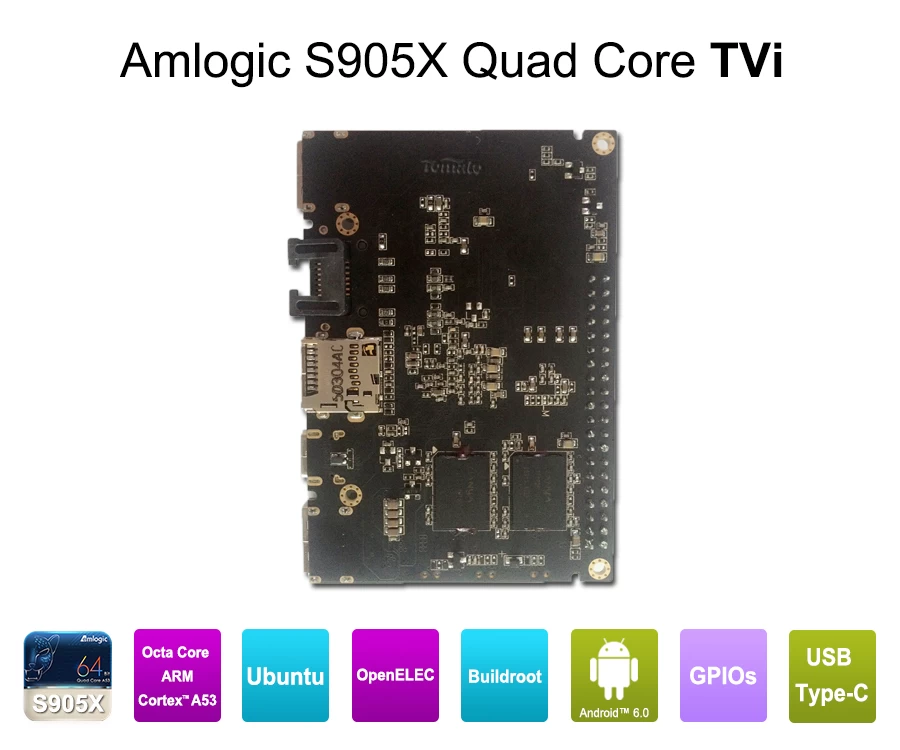

Siliziumarchitektur: Prozessoren wie der Rockchip RK3588 dominieren die aktuelle AI-Box-Landschaft und bieten neben einer Octa-Core-CPU bis zu 6,0 TOPS INT8-Rechenleistung. Dadurch kann das Gerät mehrere gleichzeitige Videostreams dekodieren und gleichzeitig komplexe Objekterkennungsalgorithmen ausführen.

-

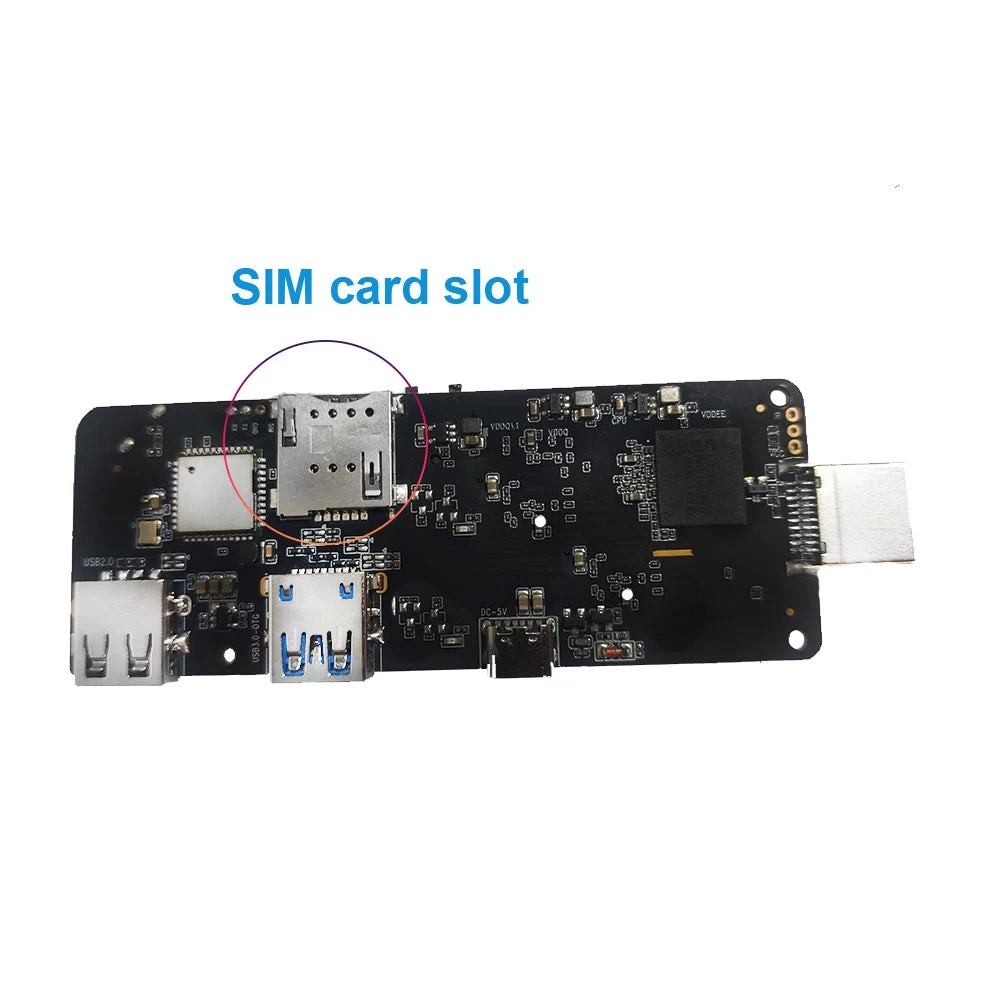

Speicherbandbreite: KI-Workloads sind speicherintensiv. Eine AI-Box, die mit Standard-DDR3- oder langsamem eMMC-Speicher ausgestattet ist, führt zu einem Engpass bei der NPU. B2B-Bereitstellungen erfordern LPDDR4x- oder LPDDR5-RAM (mindestens 8 GB für komplexe Vision-Modelle) und hochbelastbaren NVMe- oder industriellen eMMC 5.1-Speicher, um die aggressiven Lese-/Schreibzyklen des lokalisierten Datencachings zu bewältigen.

-

Thermal Design Power (TDP): NPUs erzeugen erhebliche Wärme. Ein Standard-Kunststoffgehäuse führt innerhalb weniger Stunden zu einer thermischen Drosselung, wodurch die Inferenzgenauigkeit sinkt und das Gerät unbrauchbar wird. Eine kommerzielle AI-Box erfordert ein benutzerdefiniertes PCBA-Layout, wobei die NPU physisch vom PMIC (Power Management IC) isoliert und in einem gerippten, extrudierten Aluminiumgehäuse untergebracht ist, das als passiver Kühlkörper fungiert.

Firmware-Engineering: Die übersehene Integrationsschicht

Eine AI-Box ist funktionsinert, ohne dass eine optimierte Firmware-Schicht die Hardware und die proprietäre Software des Kunden verbindet. Standard-Android-Builds (AOSP) für Endverbraucher schränken den für die Edge-Computing-Integration erforderlichen tiefen Systemzugriff ein.

Die Bereitstellung einer KI-Box im großen Maßstab erfordert eine angepasste Firmware-Entwicklung:

-

Root-Level-Zugriff und API-Hooks: Integratoren benötigen direkten API-Zugriff auf die NPU, um ihren proprietären Modellen bestimmte Hardware-Threads zuzuweisen.

-

Betriebssystemflexibilität: Während viele Digital-Signage-Anwendungen auf Android laufen, erfordern umfangreiche KI-Inferenzen oft die Stabilität und Paketverwaltung von Linux (Ubuntu/Debian). Ein leistungsfähiger Hardware-Partner muss Dual-Boot-Funktionen oder benutzerdefinierte Board Support Packages (BSP) für mehrere Betriebssysteme anbieten.

-

Fernverwaltung: Die Verwaltung einer Flotte von Edge-Computing-Geräten erfordert eine sichere Over-The-Air (OTA)-Update-Infrastruktur und Watchdog-Timer, um die Hardware im Falle eines lokalen Anwendungsabsturzes automatisch neu zu starten.

Kosten-Nutzen-Analyse: Die 18-Monats-TCO

Sind AI-Boxen den Aufpreis wert? Die Antwort liegt in der Analyse der 18-Monats-TCO. Während ein KI-Box kann im Vorfeld 200 bis 300 % mehr kosten als ein Standard-Digital-Signage-Player, die betrieblichen Einsparungen sind jedoch sofort spürbar.

Durch den Wegfall der wiederkehrenden Kosten kommerzieller ISP-Verbindungen mit hoher Bandbreite, die Reduzierung von Cloud-Computing-API-Aufrufen um 95 % und die Verwendung industrietauglicher Komponenten, die die RMA-Ausfallrate senken, liegt der Break-Even-Punkt für ein lokalisiertes Edge-Computing-Netzwerk typischerweise zwischen dem 12. und dem 18. Monat der Bereitstellung.

Für B2B-Integratoren, die auf Smart Retail, autonome Sicherheit oder industrielles IoT umsteigen, ist die AI Box ist kein freiwilliges Upgrade; es handelt sich um eine zwingende architektonische Anforderung. Um die spezifischen NPU-Anforderungen, thermischen Designs und benutzerdefinierten Firmware-Konfigurationen zu bewerten, die für Ihre Edge-Computing-Bereitstellung erforderlich sind, wenden Sie sich an einen spezialisierten OEM-Hersteller, um eine Lösung zu entwickeln, die Ihren Projektbeschränkungen entspricht.