A AI Box vale a pena?

As caixas de IA valem a pena? Uma análise técnica de ROI para integradores B2B

Depender da infraestrutura em nuvem para análise de vídeo em tempo real introduz dois pontos críticos de falha para implantações comerciais: latência inaceitável de API e custos recorrentes exorbitantes de largura de banda. Quando uma rede de sinalização digital de varejo ou uma rede de vigilância industrial exige visão computacional contínua para reconhecimento de objetos, a transmissão de feeds de vídeo brutos em 4K para um servidor centralizado é um erro arquitetônico fundamental.

Esse gargalo acelerou a adoção do Caixa de IA – um dispositivo de hardware dedicado projetado para processar cargas de trabalho de aprendizado de máquina diretamente na borda. No entanto, para responsáveis por compras B2B e integradores de sistemas, a transição de reprodutores de mídia padrão para hardware equipado com NPU exige um gasto de capital inicial significativo. Determinar se vale a pena investir em uma Caixa de IA exige uma avaliação rigorosa das capacidades de processamento localizadas, das tolerâncias térmicas e do custo total de propriedade (TCO) resultante.

O problema da largura de banda: inferência em nuvem versus computação de borda

Caixas de TV Android padrão e reprodutores de sinalização digital atuam como thin clients; eles extraem dados de um servidor e os exibem. Quando você introduz requisitos de visão computacional – como análise demográfica de público ou monitoramento de áreas restritas – SOCs (System on Chips) padrão sem unidades de processamento neural (NPUs) dedicadas sufocam a carga computacional.

A tentativa de contornar essa limitação de hardware transferindo a inferência para provedores de nuvem (AWS, Google Cloud) cria um dreno financeiro grave. Uma rede corporativa que processa centenas de fluxos de vídeo simultâneos incorre em enormes taxas de saída. A implantação de um Caixa de IA resolve isso executando os modelos de aprendizado de máquina (TensorFlow Lite, PyTorch, ONNX) localmente. A Caixa de IA processa os dados visuais, extrai os metadados (por exemplo, "Homem, 35-45 anos, olhou para a tela por 12 segundos") e envia apenas alguns kilobytes de dados de texto de volta ao servidor central. A redução nos custos de largura de banda muitas vezes justifica a atualização do hardware no primeiro ano operacional.

Avaliando benchmarks de NPU e restrições de hardware

A característica definidora de uma AI Box é o NPU, medido em TOPS (trilhões de operações por segundo). No entanto, as métricas TOPS brutas são frequentemente manipuladas nas fichas de especificações do consumidor. Para aplicações industriais, o desempenho sustentado sob carga é a única métrica que importa.

-

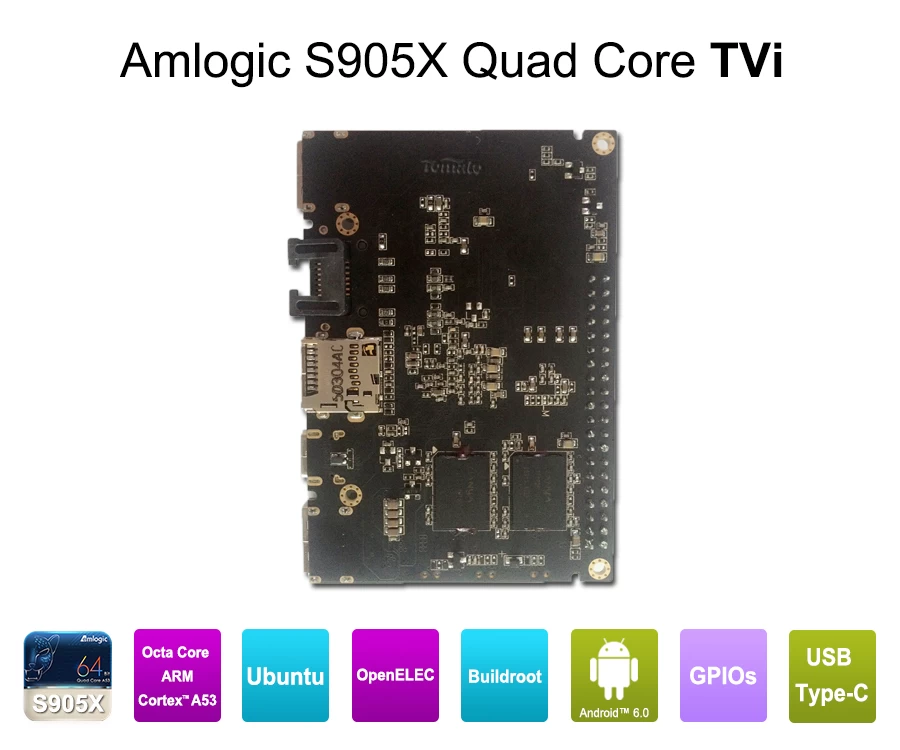

Arquitetura de silício: Processadores como o Rockchip RK3588 dominam o cenário atual do AI Box, oferecendo até 6,0 TOPS de poder de computação INT8 junto com uma CPU octa-core. Isso permite que o dispositivo decodifique vários fluxos de vídeo simultâneos enquanto executa algoritmos complexos de detecção de objetos simultaneamente.

-

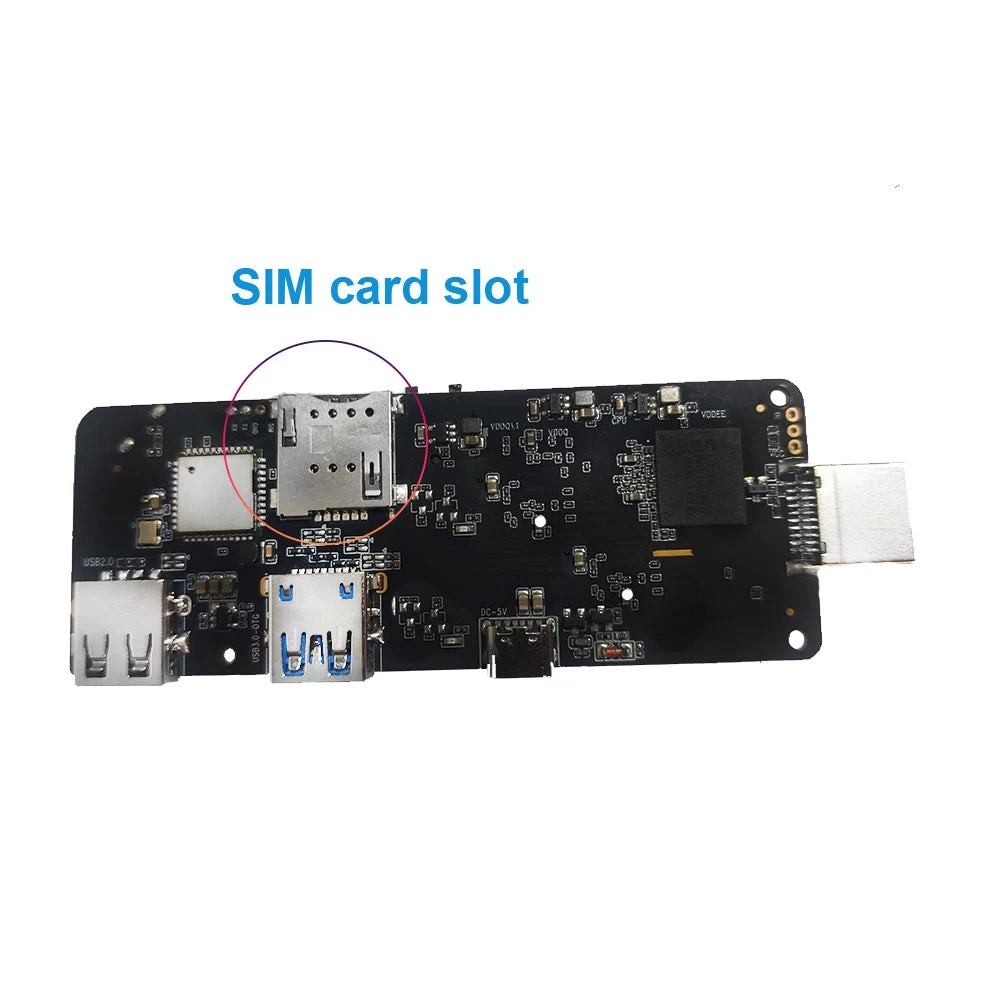

Largura de banda de memória: as cargas de trabalho de IA consomem muita memória. Uma AI Box equipada com DDR3 padrão ou armazenamento eMMC lento causará gargalos na NPU. As implantações B2B exigem RAM LPDDR4x ou LPDDR5 (mínimo de 8 GB para modelos de visão complexos) e armazenamento NVMe de alta resistência ou eMMC 5.1 industrial para lidar com os ciclos agressivos de leitura/gravação do cache de dados localizado.

-

Thermal Design Power (TDP): NPUs geram calor substancial. Um invólucro de plástico padrão causará estrangulamento térmico em poucas horas, diminuindo a precisão da inferência e inutilizando o dispositivo. Uma AI Box comercial requer um layout PCBA personalizado com o NPU fisicamente isolado do PMIC (Power Management IC), alojado em um chassi de alumínio extrudado com aletas atuando como um dissipador de calor passivo.

Engenharia de firmware: a camada de integração negligenciada

Uma AI Box é funcionalmente inerte sem uma camada de firmware otimizada que faça a ponte entre o hardware e o software proprietário do cliente. As versões prontas para uso do Android (AOSP) restringem o acesso profundo ao sistema necessário para a integração da computação de ponta.

A implantação de um AI Box em escala requer engenharia de firmware personalizada:

-

Acesso no nível raiz e ganchos de API: os integradores exigem acesso direto da API ao NPU para alocar threads de hardware específicos para seus modelos proprietários.

-

Flexibilidade do sistema operacional: embora muitos aplicativos de sinalização digital sejam executados no Android, a inferência pesada de IA geralmente requer a estabilidade e o gerenciamento de pacotes do Linux (Ubuntu/Debian). Um parceiro de hardware capaz deve oferecer recursos de inicialização dupla ou pacotes de suporte de placa (BSP) personalizados para vários sistemas operacionais.

-

Gerenciamento remoto: o gerenciamento de uma frota de dispositivos de computação de ponta requer infraestrutura de atualização Over-The-Air (OTA) segura e temporizadores de vigilância para reinicializar automaticamente o hardware no caso de falha localizada de um aplicativo.

Análise de custo-benefício: o TCO de 18 meses

As AI Boxes valem o prêmio? A resposta está na análise do TCO de 18 meses. Enquanto um AI Box pode custar 200% a 300% mais antecipadamente do que um player de sinalização digital padrão, as economias operacionais são imediatas.

Ao eliminar os custos recorrentes de conexões ISP comerciais de alta largura de banda, reduzir as chamadas de API de computação em nuvem em 95% e utilizar componentes de nível industrial que reduzem a taxa de falha de RMA, o ponto de equilíbrio para uma rede de computação de ponta localizada normalmente ocorre entre o mês 12 e o mês 18 de implantação.

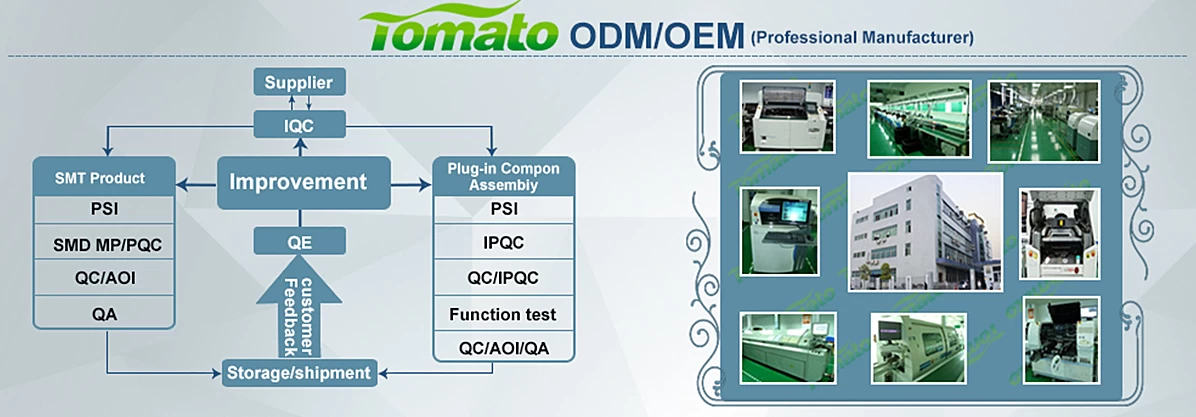

Para integradores B2B em transição para varejo inteligente, segurança autônoma ou IoT industrial, o AI Box não é uma atualização discricionária; é um requisito arquitetônico obrigatório. Para avaliar os requisitos específicos de NPU, projetos térmicos e configurações de firmware personalizadas necessárias para sua implantação de computação de ponta, consulte um fabricante OEM especializado para arquitetar uma solução que se alinhe às restrições do seu projeto.